Мошенники обманывают ярославцев цифровыми копиями их близких

Вслед за созданием фейковых аккаунтов в соцсетях и генерацией голосовых сообщений мошенники научились создавать реалистичные видеоизображения человека для обмана его родственников и знакомых.

Новый метод обмана основан на дипфейк-технологии. Она позволяет с помощью искусственного интеллекта на основе фотографий, видео и голосовых сообщений конкретного человека сгенерировать новое видеоизображение. Эти данные мошенники получают через взлом аккаунтов в социальных сетях и мессенджерах. При этом видео может быть достаточно реалистичным: копировать мимику человека, его жесты, походку, особенности внешности и т.д.

Затем мошенники записывают видеоролик с цифровым двойником, в котором он рассказывает о своей проблеме и просит перевести деньги на определенный счет. В качестве ситуации может называться болезнь, ДТП, увольнение, семейные проблемы и т.д. Видео рассылается родным и знакомым человека.

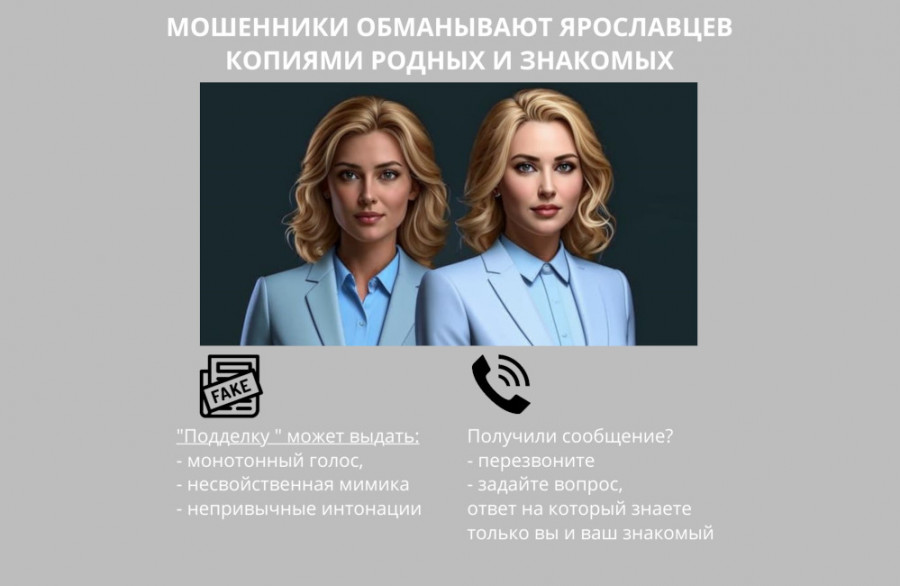

«Дипфейк-технологии развиваются быстро, а потому цифровая копия может быть очень высокого качества. Но подделку можно распознать по монотонному голосу, неестественной мимике и интонациям, дефектам звука и изображения, нереалистичным обстоятельствам из жизни конкретного человека», – считает эксперт по кибербезопасности ярославского отделения Банка России Андрей Коценко.

Если знакомый или родственник прислал видео с просьбой дать взаймы, не спешите сразу переводить деньги. Перезвоните ему, причем не на тот номер, с которого пришло сообщение, а на тот, который занесен в телефонную книгу. Если нет возможности связаться, то стоит задать в сообщении личный вопрос, ответ на который знаете только вы и ваш знакомый.

Чтобы защитить себя от подобных схем, тщательно анализируйте информацию, которую размещаете в социальных сетях, ограничьте круг тех, кто может видеть вашу страницу, а также установите надежный пароль в соцсетях и двухфакторную аутентификацию в мессенджерах.